Uzziniet Savu Eņģeļa Numuru

AI ētika: kā tirgotājiem atbildīgi jāpieņem jauninājumi

Mākslīgais intelekts (AI) nav tikai zinātniskās fantastikas fenomens, kas pārvērsts par realitāti – tas ir tehnoloģisks balsts, kas gadu desmitiem ir izstrādāts tieši zem mūsu deguna. AI ir īstenojis sapņus par paaugstinātu efektivitāti, un daudzi zīmoli jau ir izmantojuši līdzekļus AI mārketings dažu pēdējo gadu laikā.

Lai gan tas ir izraisījis sajūsmu un entuziasmu, ir bažas par AI ētiku. Tāpat kā daudzas inovācijas, tehnoloģiju nozares vīzija par metaversu bija baismīgas līdzības ar tādiem medijiem kā Black Mirror un Snow Crash . Un ar tādiem darbiem kā Līdzība par sējēju, mašīnu un es, robots kultūras laikmetā ir saprotams, kāpēc gan zinātniskās fantastikas fani, gan pētnieki, gan tehnologi brīdina par briesmām, ko rada mākslīgā intelekta ētikas ignorēšana.

Šajā rakstā mēs definēsim, kas ir AI ētika, kāpēc zīmoliem būtu jāuztraucas, un galvenās ētikas problēmas, ar kurām saskaras tirgotāji, tostarp darba drošību, dezinformāciju un algoritmisko aizspriedumu. Mēs arī pastāstīsim par piecām darbībām, kas palīdzēs jums saglabāt ētisku AI praksi komandās un visā organizācijā.

Kas ir AI ētika?

AI ētika ir morāles principu un profesionālās prakses sistēma, ko izmanto, lai atbildīgi informētu par mākslīgā intelekta tehnoloģiju attīstību un rezultātiem. Tas attiecas arī uz pētījumu par to, kā optimizēt AI ietekmi un samazināt riskus un/vai sekas.

Vadošie tehnoloģiju uzņēmumi, valdības struktūras, piemēram, Apvienoto Nāciju Organizācija, kā arī pētniecības un datu zinātnes kopienas ir strādājušas, lai izstrādātu un publicētu vadlīnijas ētikas problēmu risināšanai. Piemēram, Apvienoto Nāciju Izglītības, zinātnes un kultūras organizācija (UNESCO) 2021. gada novembrī publicēja pirmo globālo AI ētikas standartu. Ieteikums par mākslīgā intelekta ētiku .

Valsts un vietējā līmenī ir spēkā daži AI noteikumi, taču, pieaugot mākslīgajam intelektam un citām jaunām tehnoloģijām, uzņēmumiem vajadzētu sagaidīt lielāku valdības regulējumu. AI arvien vairāk integrējoties mūsu dzīvē, AI ētika kļūst par digitālās pratības būtisku sastāvdaļu.

Kāpēc AI ētika ir svarīga

Uzņēmumi jau iegulda AI, taču grūtības sagādā atbildīgas izmantošanas nodrošināšana.

13 numeroloģijas eņģelis

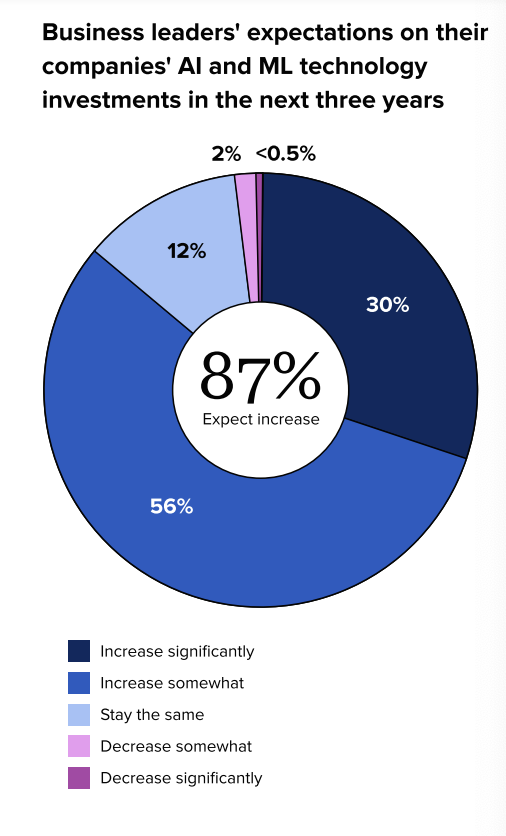

Saskaņā ar Sociālo mediju stāvoklis 2023. gadā: AI un datu pārņemšanas centrs ziņojumā, uzņēmumu vadītāji sagaida lielākus ieguldījumus AI dažu nākamo gadu laikā. Mūsu ziņojumā arī konstatēts, ka 98% uzņēmumu vadītāju piekrīt, ka uzņēmumiem ir labāk jāizprot AI un mašīnmācīšanās (ML) tehnoloģijas potenciāls, lai gūtu panākumus ilgtermiņā.

Lai gan mākslīgais intelekts var uzlabot veiktspēju, palielināt efektivitāti un radīt pozitīvus biznesa rezultātus, zīmoli piedzīvo arī neparedzētas tā izmantošanas sekas. Cita starpā tas var būt saistīts ar pētījumu trūkumu vai neobjektīvām datu kopām. AI ļaunprātīga izmantošana vai ētisku apsvērumu neievērošana var izraisīt zīmola reputācijas sabojāšanu, produkta kļūmes, tiesvedību un regulējuma problēmas.

Pirmais solis ētikas standartu ievērošanā jūsu organizācijas komandās sākas ar mārketinga speciālistu problēmu izpratni, lai jūs varētu izstrādāt plānu šo uzņēmējdarbības risku mazināšanai un sava zīmola aizsardzībai.

Kādas AI ētikas problēmas ir mārketinga speciālistu galvenais jautājums

Tehnoloģiju nozarē pastāv dažādas AI ētiskas problēmas, tostarp, bet ne tikai:

- Viltus satura ģenerēšana

- Izskaidrojamība

- Sabiedrības ietekme

- Tehnoloģiju ļaunprātīga izmantošana

- Aizspriedums

- Atbildība par datiem un privātums

- Taisnīgums

- Robustums

- Pārredzamība

- Vides ilgtspējība

- Daudzveidība un iekļaušana

- Morālā rīcības brīvība un vērtību saskaņošana

- Uzticība un atbildība

Daži uzskata, ka mākslīgais intelekts var palīdzēt izveidot iekļaujošākas tehnoloģijas, sistēmas un pakalpojumus, kas var apmierināt dažādas iedzīvotāju grupas. Galvenais ir izveidot ētiskus ietvarus, noteikumus un mehānismus, lai nodrošinātu atbildīgu izmantošanu.

Dalībnieks no dendrārijs , Sprout kopienas forums, atzīmēja, ka mākslīgais intelekts var veicināt iekļaušanu un samazināt aizspriedumus/diskrimināciju, nodrošinot godīgus, objektīvus lēmumu pieņemšanas procesus. Risinot tādas problēmas kā algoritmiskā novirze AI attīstībā, varētu būt iespējams veidot nākotni, kurā AI ir pozitīvs pārmaiņu spēks.

Līdz ar pozitīvu pārmaiņu potenciālu pastāv arī iespējas ļaunprātīgi vai neētiski izmantot AI, jo tas kļūst spēcīgāks. Mūsu kopiena apsprieda vairākus riskus, tostarp privātuma pārkāpumus, manipulācijas ar sabiedrisko domu un autonomus ieročus.

Šādi komentāri tikai saskrāpē ētikas problēmas dažādās nozarēs, taču galvenās mārketinga speciālistu problēmas ir šādas: darba drošība, privātums, aizspriedumi un diskriminācija, dezinformācija un dezinformācija, kā arī intelektuālā īpašuma/autortiesību problēmas, kuras mēs sīkāk aplūkosim nākamā sadaļa.

Ietekme uz darbavietām un darba vietu pārvietošanu

Roboti, kas nodrošina pasaules kundzību, ir vismazākais no mūsu raizēm — vismaz pagaidām.

Un tas ir tāpēc, ka pētniekus un ekspertus tas neapdraud tehnoloģiju savdabība , vai ideja, ka AI pārspēs cilvēka intelektu un atkārtos tādas iezīmes kā sociālās prasmes. Viņi apzinās AI ierobežojumus un iespējamās darba aizstāšanas sekas.

Izpētes mērķis un ieguldot AI nav aizstāt cilvēkus — tas palīdz mums ietaupīt laiku un pūles, lai paveiktu ietekmīgākas lietas. Flock Freight sociālo mediju un partnerattiecību direktors Bobs Vollijs dalījās ar lielisku analoģiju ar AI : “AI ir kā trauku mazgājamā mašīna vai veļas mašīna mūsu mājās. Padomājiet par visu laiku, ko ietaupāt, nevis mazgājot traukus vai drēbes ar rokām.

Mūsu sērijā Nelasītie Sprout mārketinga un radošās komandas dalībnieki apsprieda, kā viņi pašlaik izmanto AI, sākot ar personalizētu iepirkšanos un beidzot ar tādu funkciju izmantošanu kā ViralPost®, lai palīdzētu plānot sociālos ierakstus. Noskatieties tālāk redzamo videoklipu, lai uzzinātu, kādas ir viņu iecienītās AI priekšrocības un bailes, tostarp darba aizstāšana.

Bažas par privātumu

Bažas par datu privātumu, aizsardzību un drošību ir zīmoliem galvenais. Ieguldījumi drošībā ir arvien lielāka uzņēmumu prioritāte, jo tie cenšas izvairīties no jebkādām novērošanas, hakeru un kiberuzbrukumu iespējām. Tā kā personalizācija kļūst arvien populārāka, zīmoli ievieš datu vākšanas, uzglabāšanas un analīzes paraugpraksi, lai aizsargātu klientus un organizācijas.

Algoritmiskā novirze un diskriminācija

Tā kā tas mācās no datiem, slikti konstruēts vai apmācīts AI var demonstrēt neobjektivitāti pret nepietiekami pārstāvētām datu apakškopām. Ir bijuši vairāki lieli neobjektivitātes gadījumi ar AI ģenerētiem mākslas darbiem, tērzēšanas robotiem, sejas atpazīšanas programmatūru, algoritmiem un AI rīkiem darbā pieņemšanas prakse .

Piemēram, vairāki TikTok un Twitter [no 2023. gada jūlija pārdēvēta par X] lietotāji izsauca pavedienu, kurā redzams “#SouthSudan Barbie”, kas rotāts ar ieročiem, kas ir negatīvs stereotips, kas saistīts ar reģionu, kas cīnās ar sociālpolitiskām problēmām, piemēram, genocīdu un bēgļu krīzēm. .

Tā kā AI izmanto šādus gadījumus ar vēl zemākām likmēm, rodas jautājums, kā cīnīties pret neobjektivitāti un diskrimināciju, ja apmācības datu kopas var būt neobjektīvas?

Dezinformācija un dezinformācija

Tāpat kā cilvēki, AI nav ideāls. AI atbildes uz uzvednēm var būt neprecīzas, un pastāv bažas, ka cilvēki ļaunprātīgos nolūkos izplatīs dezinformāciju. Līdzās dezinformācijas draudiem pastāv zīmola krīze un reputācijas kaitējums, jo īpaši bez atbilstošiem drošības pasākumiem un protokoliem.

Intelektuālā īpašuma un autortiesību jautājumi

Droši vien esat redzējuši Harija Potera lomu tēlotājus Vesa Andersona filmā vai Bikini Bottom iedzīvotājus dziedam populāru dziesmu izpildījumus. Šie ir piemēri tam, cik daudzi izmanto AI, lai izmantotu cilvēku tēlu un līdzību vai intelektuālo īpašumu.

AI ir lielisks sparinga partneris radošiem uzdevumiem, piemēram, prāta vētrai un kontūru veidošanai, taču atkarībā no tā, kā tiek izmantoti rezultāti, tas var izraisīt autortiesību pārkāpumus, plaģiātu un intelektuālā īpašuma pārkāpumus. Piemēram, mākslinieku grupa iesniedza prasību tiesā pret Midjourney un Stability AI 2023. gada janvārī, apgalvojot, ka ar rīkiem tiek pārkāptas miljoniem mākslinieku tiesības. Ģeneratīvais mākslīgais intelekts atver legālu tārpu kannu, un vēl ir daudz darāmā, taču proaktīvu noteikumu un sistēmu izveide palīdzēs mazināt ētiskos riskus.

5 soļi, lai saglabātu AI ētiku komandās

Šeit ir pieci soļi, kas palīdzēs vadīt AI ētisko risku mazināšanas plānu.

1. Iestatiet iekšējos pamatnoteikumus un pienākumus AI lietošanai

Apsveriet iespēju izveidot mākslīgā intelekta ētikas komandu, kurā būtu ētikas speciālisti, juridiskie eksperti, tehnologi un vadītāji, lai palīdzētu noteikt jūsu organizācijas pamatnoteikumus. Piemēram, ģeneratīvā AI izmantošana tikai melnrakstiem un prāta vētrai, bet ne ārēji publicētam saturam ir lielisks pamatnoteikums.

Kopā ar šiem pamatnoteikumiem definējiet katra AI iesaistītā komandas locekļa, tostarp ētikas komandas, lomu un pienākumus. Iestatiet savus mērķus un vērtības arī attiecībā uz AI. Tas palīdzēs izveidot pamatu jūsu AI ētikas politikai un paraugpraksei.

2. Definēt un pārbaudīt AI lomu

AI nevar aizstāt satura veidotājus, sociālo mediju stratēģus vai faktiski nekādu lomu mārketingā. Nosakiet AI uzdevumus, kuriem nepieciešama cilvēka uzraudzība vai iejaukšanās, un precīzi nosakiet savas AI ētikas politikas mērķus, lai palīdzētu izstrādāt procesus AI izstrādei, pārvaldībai un saziņai par to.

Kad esat noskaidrojis savas ētikas politikas mērķus, identificējiet AI nepilnības un iespējas savā organizācijā. Apsveriet šādus jautājumus:

- Kā organizācija pašlaik izmanto AI un kā mēs vēlamies to izmantot nākotnē?

- Kāda programmatūra un analīze var mums palīdzēt mazināt uzņēmējdarbības riskus?

- Kādas nepilnības rada tehnoloģija un analīze? Kā mēs tos piepildām?

- Kādi testi vai eksperimenti mums ir jāveic?

- Kādus esošos risinājumus mēs varam izmantot ar pašreizējo labāko praksi mūsu produktu komandām?

- Kā izmantosit datus un ieskatus?

- Kā mēs izveidosim sava zīmola pozicionēšanu un ziņojumapmaiņu AI tehnoloģijām un ētikai?

3. Izstrādāt hermētisku pārdevēja novērtēšanas procesu

Sadarbojieties ar savām IT un juridiskajām komandām, lai pareizi pārbaudītu visus rīkus ar AI iespējām un izveidotu ētisku riska procesu. Viņu zināšanas palīdzēs jums novērtēt jaunus apsvērumus, piemēram, datu kopu, par kuru rīks ir apmācīts, un pārdevēju vadības ierīces, lai mazinātu AI novirzes. Katra rīka uzticamības pārbaudes process pirms ārējās vai iekšējās palaišanas palīdzēs jums mazināt turpmākos riskus.

4. Saglabājiet atklātības atklātību

Sadarbojieties ar savām juridiskajām un/vai privātuma komandām, lai izstrādātu ārēju ziņojumapmaiņu un/vai atrunas, lai norādītu, kur un kad jūsu zīmols paļaujas uz AI. Šos ziņojumus var izmantot saturam, klientu apkalpošanai utt. Piemēram, TikTok atjaunināja savus kopienas vadlīnijas pieprasīt, lai satura veidotāji marķē AI radītu saturu. Paziņojot par saviem ētikas standartiem un ietvariem mākslīgā intelekta ētikas aizstāvēšanai, jūs iegūsit vienaudžu, potenciālo klientu un klientu uzticību.

1222 eņģeļu numuri

5. Turpiniet izglītoties starp vadītājiem un komandām

AI nav kaut kas biznesa vadība var steigties iekšā. Tāpat kā jebkurš jauns jauninājumu vilnis, papildus jauniem tehnoloģiskiem pavērsieniem būs mācīšanās līkne. Palīdziet izlīdzināt konkurences apstākļus, rīkojot iekšējas apmācības un seminārus, lai izglītotu visus komandas locekļus, vadītājus un ieinteresētās personas par AI ētiku un to, kā to veidot atbildīgi.

Rīkojieties pareizi ar AI ētiku

Ētikas ievērošana nav tikai pareizā rīcība — tā ir būtiska AI tehnoloģijas izmantošanas sastāvdaļa uzņēmējdarbībā.

Uzziniet vairāk no līderu un mārketinga speciālistu viedokļiem par to, kā AI ietekmēs mūsu sociālo nākotni vebinārs, kopā ar citiem atklājumiem no 2023. gada ziņojuma par sociālo mediju stāvokli un padomiem, kā izveidot ietekmīgu sociālo saturu.

Dalieties Ar Draugiem:

![Lietotāja atbilde uz mākslīgā intelekta ģenerētu fotoattēlu ar '#SouthSudan Barbie' Twitter pavedienā [no 2023. gada jūlija pārdēvēta par X]. Ziņojumā ir teikts: 'Mēs turpinām jums teikt'all that bias is built into this AI-generated garbage."](https://clarksbarandrestaurant.com/img/all-marketing-insights/C2/ai-ethics-how-marketers-should-embrace-innovation-responsibly-3.png)